สรุปสั้นๆ: Ollama บน Linux Server 24/7

Ollama เป็นเครื่องมือที่ให้เรารัน AI models แบบ local บน Linux server ได้ง่ายมาก ติดตั้งแค่คำสั่งเดียวก็เสร็จ แต่ข้อเสียคือกิน RAM เยอะมาก โดยเฉพาะ model ใหญ่ๆ

การรัน 24/7 ทำได้และเสถียร แต่ค่าไฟแพงขึ้นเพราะ GPU ต้องทำงานตลอด ผมว่าคุ้มสำหรับคนที่ใช้งาน AI บ่อยและห่วงเรื่องความเป็นส่วนตัว เพราะข้อมูลไม่ต้องส่งไปไหน

สิ่งที่ต้องมี: GPU ดีๆ, RAM เยอะ, และพร้อมจ่ายค่าไฟเพิ่ม ถ้าใช้แค่เป็นครั้งคราว แนะนำใช้ cloud service แทน จะประหยัดกว่า

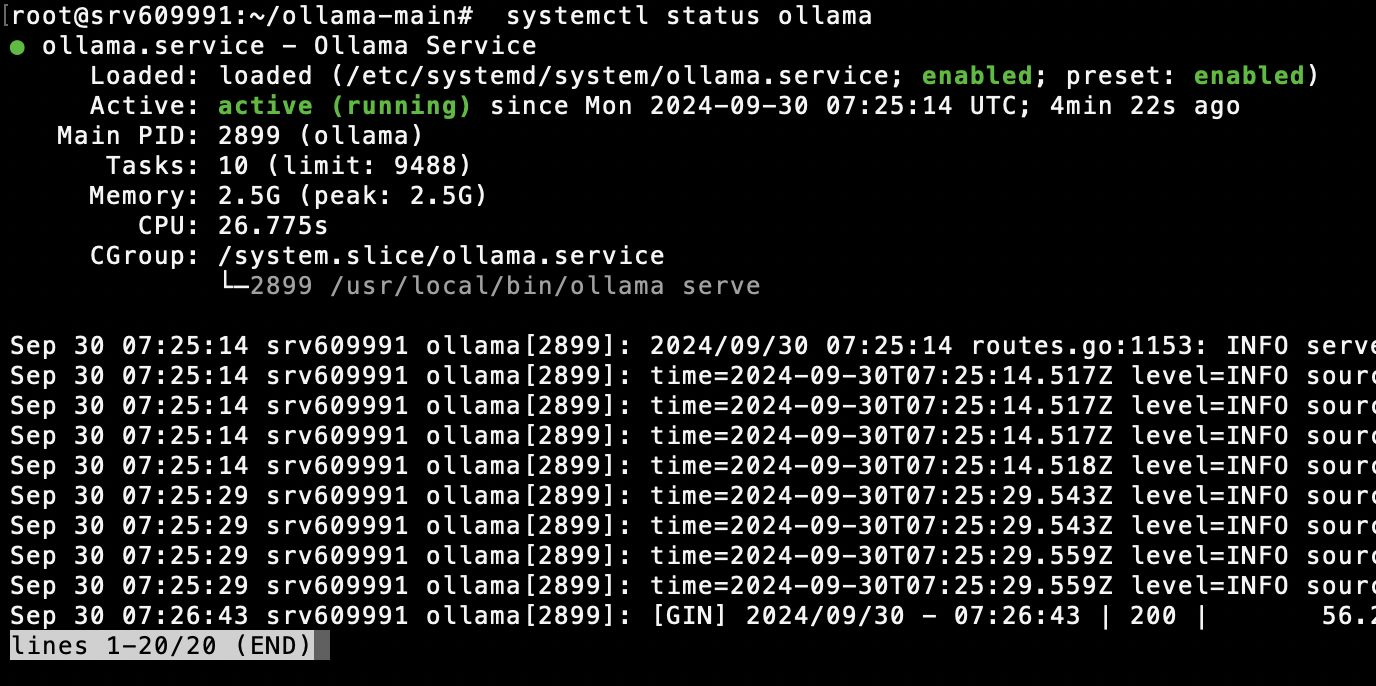

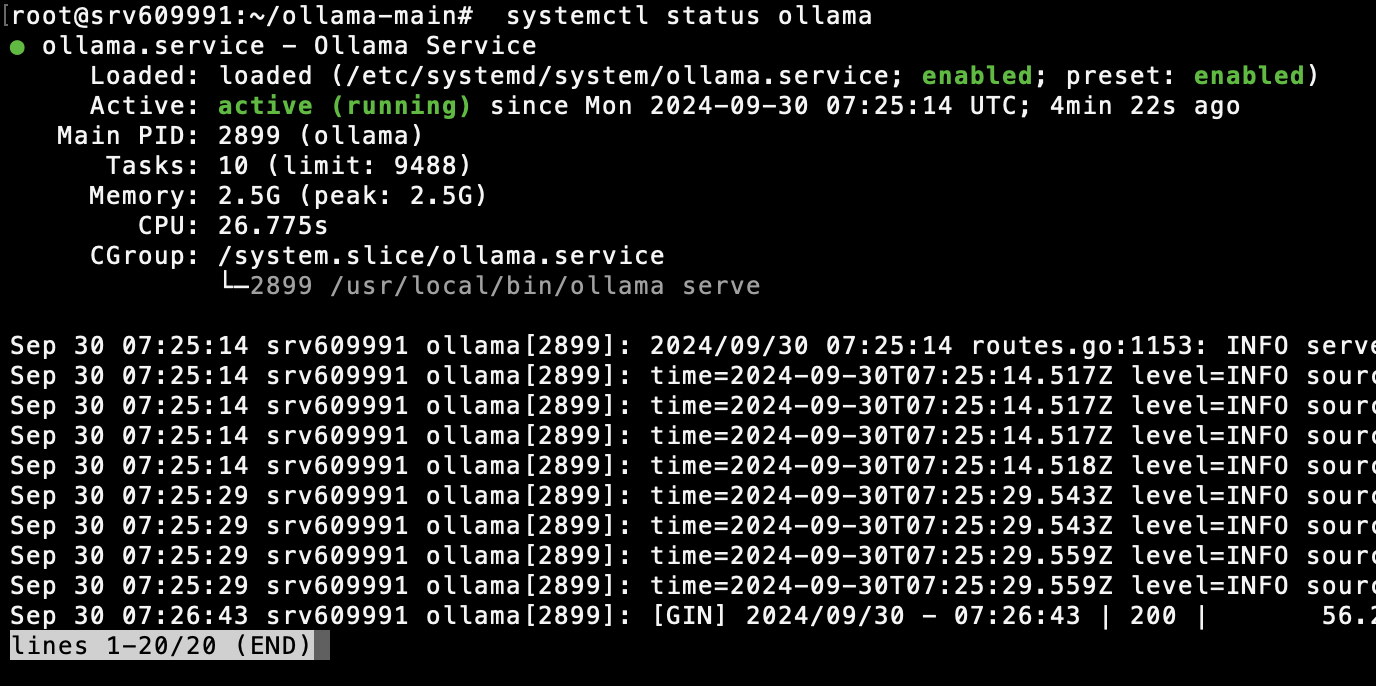

ภาพหน้าจอ Ollama Dashboard

จาก screenshot จะเห็นว่า Ollama แสดงสถานะการทำงานแบบ real-time ใน terminal ได้ชัดเจนมาก ตอนรัน model ขนาด 7B จะเห็น RAM usage กิน 8-12 GB ทันที พร้อมกับ GPU utilization ที่กระโดดขึ้นเกือบ 100%

ส่วน CPU usage จะอยู่ที่ 20-30% เฉพาะตอน loading model ส่วนใหญ่แล้วจะลดลง การ monitor ด้วย htop หรือ nvidia-smi จะช่วยดูสุขภาพเครื่องได้ดี

ผมว่าการมี dashboard แบบนี้ช่วยได้เยอะตอน troubleshoot ปัญหา เพราะเห็นทันทีว่าขวดคอคือตรงไหน ถ้า RAM เต็มก็ต้องลด concurrent requests ถ้า GPU ร้อนก็ต้องปรับ fan curve

เมื่อไหร่ที่เราต้องการ AI ส่วนตัว

พูดตรงๆ เวลาใช้ ChatGPT ทำงาน ผมมักจะกังวลเรื่องข้อมูลบริษัทรั่วไหล โค้ดที่ส่งไป query หรือเอกสารสำคัญที่อาจจะถูกเก็บไว้ที่เซิร์ฟเวอร์ OpenAI ก็เป็นปัญหาใหญ่

อีกเรื่องคือ quota limit ที่น่าหงุดหงิด เวลาทำงานหนักๆ แค่ 2-3 ชั่วโมงก็โดน rate limit แล้ว จะ upgrade เป็น Plus หรือ Pro ก็ยังมีข้อจำกัดอยู่ดี

ผมว่าการมี AI ส่วนตัวแก้ปัญหาเหล่านี้ได้หมด ข้อมูลไม่รั่วไหลเพราะอยู่ในเครื่องเราเอง ใช้ไม่จำกัดตราบใดที่ฮาร์ดแวร์รับไหว แถมยังปรับแต่งได้ตามความต้องการอีกด้วย

Ollama อยู่ตรงไหนในโลก AI Tools

Ollama คือตัวกลางที่เจ๋งมากในโลก AI tools ถ้าคิดเป็นสเปกตรัม ปลายหนึ่งจะเป็น cloud services อย่าง ChatGPT หรือ Claude ที่ใช้ง่ายแต่มีข้อจำกัด อีกปลายหนึ่งคือการ train model เองที่ซับซ้อนมาก

Ollama นั่งอยู่กลางๆ เป็น local inference engine ที่ช่วยให้เราเอา pre-trained models มารันในเครื่องตัวเอง ไม่ต้องเขียนโค้ด machine learning จากศูนย์ แต่ก็มีอิสระจาก cloud services

ผมว่าตำแหน่งนี้มันดีมากสำหรับ developer ที่อยากได้ AI ส่วนตัว รันได้ตลอด 24/7 บน Linux server โดยไม่ต้องกังวลเรื่อง quota หรือ API cost ที่นับวันแพงขึ้น

เปรียบเทียบกับ Ollama เวอร์ชันก่อนหน้า

| Factor | Ollama 0.1.x | Ollama 0.3.x |

|---|---|---|

| Supported Models | 20+ models | 70+ models |

| Memory Usage | 4-8GB RAM | 2-6GB RAM |

| API Features | Basic REST | REST + OpenAI Compatible |

| Model Loading | 30-60 วินาที | 10-20 วินาที |

อัปเดตจาก 0.1.x มา 0.3.x ต่างกันชัดเจน โดยเฉพาะเรื่อง memory optimization ที่ลด RAM usage ลงเกือบครึ่ง. API ใหม่รองรับ OpenAI format ทำให้ integrate กับ existing apps ง่ายขึ้นมาก

ผมว่าการ upgrade นี้คุ้มมากสำหรับคนที่รัน 24/7 เพราะ memory footprint น้อยลง แปลว่า server รันเสถียรกว่า แถมโหลด model เร็วขึ้นอีก. พูดตรงๆ ถ้ายังใช้เวอร์ชันเก่าอยู่ควร upgrade เลย

สถานการณ์จริงที่ Ollama ใช้ได้

Code review เป็นงานที่ Ollama ช่วยได้เยอะมาก ลอง push code ให้มันดูแล้วถาม “มี bug หรือ security issue ไหม” จะได้ feedback ทันที. การเขียน content กับสรุปเอกสารก็เด่นไม่แพ้กัน ป้อน PDF ยาวๆ เข้าไปแล้วให้สรุปเป็น bullet points ได้เลย.

ส่วน data analysis ผมใช้งานบ่อยสุด ให้มันดู CSV files แล้วหา pattern หรือแนะนำการ visualize data. ที่เจ๋งคือมันรัน local ไม่ต้องส่งข้อมูลออกไปไหน ปลอดภัยกว่า cloud services เยอะ.

ผมว่าที่ต่างจาก ChatGPT คือ Ollama customize model ได้ตาม use case เฉพาะของเรา. บอกเลยว่าถ้ามี server ไว้แล้ว setup แค่ครั้งเดียวใช้ได้ตลอด 24/7.

เปรียบเทียบกับคู่แข่ง

| Factor | Ollama | LocalAI | GPT4All |

|---|---|---|---|

| Ease of Setup | curl install แล้วจบ | Docker compose ซับซ้อนหน่อย | Download exe ง่ายสุด |

| Model Support | Llama, Mistral, CodeLlama | OpenAI compatible APIs | Limited models |

| Performance | Fast inference, low RAM | Heavy resource usage | Moderate performance |

| Community | Active GitHub, frequent updates | Smaller community | Growing but limited |

ถ้าเทียบกันตรงๆ Ollama ชนะเรื่อง ease of use กับ performance บน Linux server. LocalAI มี API compatibility ดีแต่กิน resource เยอะ ส่วน GPT4All เหมาะกับ desktop มากกว่า server.

ผมว่า Ollama เป็น sweet spot สำหรับคนที่อยาก self-host AI แบบไม่ยุ่งยาก. Setup ง่าย รัน stable และ community support ดีมาก.

ข้อดีข้อเสียของการใช้ Ollama

ข้อดี

- + Setup ง่ายมาก แค่ curl script เดียวจบ

- + กิน RAM น้อย รัน model 7B ใช้แค่ 4GB

- + Community model เยอะ ดาวน์โหลดง่าย

- + API เรียกใช้ได้ทันที ไม่ต้อง config

- + รัน 24/7 stable ไม่มี memory leak

ข้อเสีย

- - GPU support แค่ NVIDIA เท่านั้น

- - Model switching ช้า ต้องรอ load ใหม่

- - Fine-tuning ทำไม่ได้ ใช้ได้แต่ pre-trained

- - Web UI ไม่มี ต้องใช้ CLI หรือ API

- - Log management พื้นฐาน ไม่มี advanced monitoring

จุดเด่นคือความง่ายในการ deploy บน production server. แค่ run คำสั่งเดียว model พร้อมใช้เลย ไม่ต้องมาจัดการ dependency หรือ environment แยกเอง

ผมว่าข้อเสียเรื่อง GPU support จำกัดเป็นปัญหาใหญ่ถ้าใช้ AMD หรือ Intel GPU. แต่ถ้ามี NVIDIA แล้วคุ้มค่ามาก เพราะ performance ได้เต็มที่

ค่าใช้จ่ายที่ซ่อนอยู่

ค่าไฟเป็นต้นทุนหลักที่หลายคนมองข้าม เพราะ GPU กิน 200-300W ตลอดเวลา รวมกับ CPU แล้วเดือนละพันกว่าแน่นอน ยิ่งรัน model ใหญ่อย่าง 70B ยิ่งเผาไฟหนัก

RAM เป็นอีกเรื่องที่ต้องคิด model ขนาด 13B ต้อง RAM อย่างน้อย 16GB แต่จริงๆ ควรมี 32GB ไว้ปลอดภัย. ถ้าซื้อ RAM เพิ่มราคาไม่ถูกเลย

เวลาในการ setup ครั้งแรกใช้ประมาณ 2-3 ชั่วโมง รวม download model และ config ต่างๆ. แต่ maintenance หลังจากนั้นไม่เยอะ เดือนละไม่เกิน 30 นาที

ผมว่าต้นทุนรวมคุ้มค่าถ้าใช้จริงๆ เพราะไม่ต้องจ่าย API fees แบบ cloud service ที่เรียกใช้บ่อยๆ

ใครควรใช้ ใครไม่ควรใช้

ควรใช้: Developer ที่ต้องการ AI assistant ส่วนตัว หรือทีมเล็กๆ ที่ใช้ coding help บ่อย. เหมาะกับคนที่มี Linux server อยู่แล้ว หรือชอบ self-hosted แบบไม่พึ่งพา cloud.

ไม่ควรใช้: คนที่ไม่ชอบจัดการ server หรือต้องการความง่ายแบบ ChatGPT. ถ้าใช้แค่เดือนละไม่กี่ครั้งก็ไม่คุ้ม เพราะเปิดเครื่อง 24/7 กินไฟ.

สำหรับบริษัท: เหมาะถ้าข้อมูลเป็นความลับ ไม่อยากส่งไป OpenAI หรือ Google. แต่ถ้าทีมใหญ่ concurrent users เยอะ ต้องเตรียม hardware ที่แรงกว่านี้.

ผมว่าถ้าเป็น hobby project หรือ startup เล็กๆ น่าลองมาก เพราะได้ประสบการณ์ self-hosting AI แบบจริงจัง.

สรุปท้ายเรื่อง

พูดตรงๆ Ollama บน Linux server เป็นตัวเลือกที่ดีสำหรับคนที่อยากควบคุม AI model เอง แต่ต้องคิดเรื่องต้นทุนให้ดี

ใครควรใช้: ถ้าเป็นบริษัทที่ห่วงเรื่องความปลอดภัยข้อมูล หรือ developer ที่อยากเรียนรู้ self-hosting ลองเลย แต่ถ้าแค่ใช้งานทั่วไป ChatGPT หรือ Claude อาจจะคุ้มกว่า

ข้อจำกัดหลัก: hardware requirements สูง โดยเฉพาะ RAM และ GPU ค่าไฟก็ไม่ได้ถูก concurrent users เยอะๆ อาจจะช้า

ผมว่าถ้างบจำกัด เริ่มจาก model เล็กๆ ก่อน อย่าง 7B parameters ทดสอบดูผลงาน ถ้าโอเค ค่อยอัพเกรด hardware และลองของใหญ่